当 GitHub 在 6 月宣布正式以每月 10 美元的价格出售 Copilot 时,虽有部分人控诉 GitHub 搞“价格双标”,但多数程序员还是一致认为:每个月花 10 美元买一个会自动写代码的 AI 编程“神器”是值得的。

然而,要是这个神器突然“哑巴”了呢?上个月,一位名为 Hugo REY 的用户在 GitHub 上发起了一个讨论:“我的部分代码让 Copilot 崩溃了”。

突然“哑巴”了的 Copilot

作为基于 OpenAI Codex 算法之上构建的自动编码辅助工具,GitHub Copilot 被许多程序员视为最佳“编程神器”的优势在于:Copilot 可查看当前文件中现有的代码/注释,结合上下文语义,自动推荐/生成一行或多行代码供其选择,很大程度上解放了程序员的双手。甚至随着时间的推移,Copilot 还能在程序员接受或拒绝建议的过程中不断学习,变得更加智能全面。

以上一切优点的前提,是 Copilot 会自动生成代码建议——但 Hugo REY 指出,他用的 Copilot 经常突然就“哑巴”了。

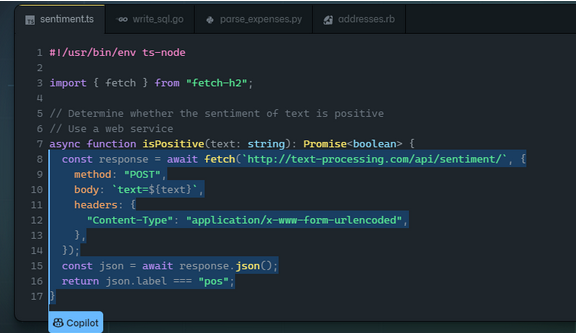

“我这阵子在用 Copilot,挺好用的,但不知道为啥老是用 2 分钟它就不再给出代码建议了。昨天也是这样,不过今早莫名又恢复正常了……然后现在它又不行了。”

刚开始,Hugo REY 认为问题可能在 Copilot 上,因此他试了很多种方法,包括:在扩展程序中重新登录、重新加载、重新安装、重启 VS Code、重启计算机,还试着检测 Copilot 是否会对其他文件/语言给出建议。

感到纳闷的 Hugo REY 在经过以上反复尝试后,最终推测可能是他写的代码不小心给 Copilot 搞“崩”了。

//descriptions is a global object export function description(name,age,gender,stats){

var descriptionGenerated="";

//wealth category

var familyType="";

if (stats.wealth>=8) familyType="rich";

else if(stats.wealth>=6) familyType="aisée";

else if(stats.wealth>=4) familyType="modeste";

else familyType="pauvre";

//baby description

if(age<=3)

{

//get random baby description

var descriptionId = Math.floor(Math.random()*descriptions.template.baby[gender].length);

descriptionGenerated = formated(descriptions.template.baby[gender][descriptionId],{name:name,age:2,face:"test",eyes:"",familyWealth:familyType,future:"nul"});

}

//standard description

return descriptionGenerated;

}更具体一点的话,以下这部分代码应该就是“罪魁祸首”。

//baby description if(age<=3){

//get random baby description

var descriptionId = Math.floor(Math.random()*descriptions.template.baby[gender].length);

descriptionGenerated = formated(descriptions.template.baby[gender][descriptionId],{name:name,age:2,face:"test",eyes:"",familyWealth:familyType,future:"nul"});}本来 Copilot 应该在这段代码之后给出建议的,但 Hugo REY 按下回车之后却无事发生,日志显示以下内容:

[INFO] [default] [2022-07-10T07:59:07.641Z] [fetchCompletions] engine https://copilot-proxy.githubusercontent.com/v1/engines/copilot-codex[INFO] [default] [2022-07-10T07:59:07.737Z] request.response: [https://copilot-proxy.githubusercontent.com/v1/engines/copilot-codex/completions] took 96 ms所以,尽管定位出了导致 Copilot 崩溃的代码具体位置,但 Hugo REY 还是不理解这段代码到底有什么问题。他将这些细节及问题都发布到了 GitHub 上,希望广大开发者能为其答疑解惑。

“gender(性别)”是敏感词?

起初,Hugo REY 提出的这个问题并未引起开发者们的注意,直到昨天一位名为“DenverCoder1”在仔细阅读代码后才推测出了问题所在:

这个问题可能在于你的代码里使用了“gender(性别)”一词。

很不巧的是,Copilot 有一个内容过滤器,导致它不会对涉及“gender(性别)”的代码提出任何建议。

我希望未来 Copilot 开发团队能解决这个问题。

显然,在许多开发者看来,这个原因有些出人意料、甚至有些离谱,但有开发者测试后发现,真相确实如此。

我刚刚测试了一下,我可以确认,Copilot 确实会拒绝给出有关性别的建议。我知道很多人都认为这很荒谬,但细想后就会意识到,一旦 Copilot 对此给出建议,微软将面临两种公关噩梦。

1、如果 Copilot 提出了一个暗示性别是二元(只有男性和女性)的建议,某个特定社区必将爆发抗议,之后新闻界就会开始炒作关于微软如何用代码强制执行性别观点的话题。

2、如果 Copilot 提出了一个暗示性别是非二元的建议,另一个特定社区也肯定会爆发抗议,然后新闻界就会开始炒作另一个话题……

对于这种说法,很多开发者还是无法接受 Copilot 仅因“gender(性别)”这个词就失效了。他们认为,既然最终的代码选择权在用户手里,那 Copilot 该生成的建议还是可以生成的:

-

“Copilot 是一款面向成年人的产品,你可以让它生成该建议的内容,因为成年人应该都能理解什么是机器学习吧?最终将 Copilot 生成的建议迁怒到微软头上的怕不都是傻子吧。”

同时也有人指出,在 Copilot 中设置内容过滤器这个行为本身就有问题:

-

“大家都在关注 Copilot 就‘gender(性别)’一词上触发其内容过滤器的愚蠢程度,但对我来说,真正的问题在于 Copilot 为什么会有一个内容过滤器?这显然是不受欢迎也不必要的。”

那么在你看来,作为 AI 自动编程工具的 Copilot,其中是否应该设置内容过滤器?因涉及敏感词就“失效”的设定又是否合适?

参考链接:

-

https://github.com/orgs/community/discussions/20273

-

https://news.ycombinator.com/item?id=32338469

文章评论